Wie synthetische Daten Weizen-Detektoren auf unbekannten Feldern helfen

Auf bekannten Feldern schlagen reale Fotos synthetische Daten fast immer. In einem neuen Land, mit einer neuen Kamera, in einer neuen Saison kehrt sich das um. Wir haben das am Global Wheat Head Detection Benchmark gemessen.

Ein Weizenähren-Detektor, der auf einem Betrieb trainiert wurde, verliert beim Wechsel auf den nächsten häufig seine Genauigkeit. Anderer Boden, andere Kameras, andere Wachstumsstadien, anderes Wetter. Im Trainingsset war nichts davon enthalten, und das schlägt sich direkt in der Modellleistung nieder.

Für genau dieses Problem sind synthetische Daten gemacht. Man kann Felder aus jeder Region, mit jedem Sensor und zu jeder Tageszeit rendern, und die Labels entstehen dabei automatisch. Deshalb haben wir einen kontrollierten Test auf dem Global Wheat Head Detection-Benchmark durchgeführt, einem Datensatz, der aus Forschungsstationen in Frankreich, der Schweiz, Großbritannien und Kanada zusammengestellt wurde. Trainiert haben wir mit den Daten aus Frankreich, getestet auf Daten aus Kanada und Großbritannien. Die Frage dahinter ist einfach: Wie schlagen sich synthetische Daten, wenn das Testset wirklich neues Terrain darstellt?

Die Kurzfassung: Auf bekannten Feldern gewinnen echte Fotos fast immer. Auf unbekannten Feldern gehören synthetische Daten zu den wertvollsten Trainingssignalen, die man ergänzen kann. Und ein Mix aus synthetischen und realen Bildern schlägt jede Quelle für sich genommen, selbst dann, wenn man das reale Budget verdreifacht.

Die Frage, die wir beantworten

Bei der Objekterkennung in der Landwirtschaft ist die Kostenasymmetrie erheblich. Das Annotieren eines einzigen echten Weizenfeld-Bildes kann zwischen 20 und 40 Minuten dauern. Ein Simulator dagegen erzeugt Tausende Bilder pro Stunde, samt pixelgenauer Labels und ohne zusätzlichen Aufwand. Der Haken ist die Sim-to-Real-Lücke: Modelle, die auf synthetischen Daten trainiert wurden, schneiden auf synthetischen Daten zwar ausgezeichnet ab, scheitern aber auf echten Feldern. Besonders dann, wenn diese ganz anders aussehen als das, was der Simulator nachgebildet hat.

Wir haben drei Quellen isoliert und gegeneinander getestet:

Real. Annotierte Fotos aus dem GWHD-Datensatz, dem Goldstandard.

Synthetic. Prozedural gerenderte Felder aus unserer Engine, deren Bounding Boxes direkt aus der 3D-Szene abgeleitet werden.

GenAI. Synthetische Bilder, die durch ein Image-to-Image-Diffusionsmodell überarbeitet wurden. Die Prompts verändern Beleuchtung, Wetter und Atmosphäre, erhalten dabei aber die Pflanzengeometrie. Dadurch bleiben die ursprünglichen Bounding Boxes gültig. So entsteht günstige visuelle Vielfalt auf Basis perfekter Labels.

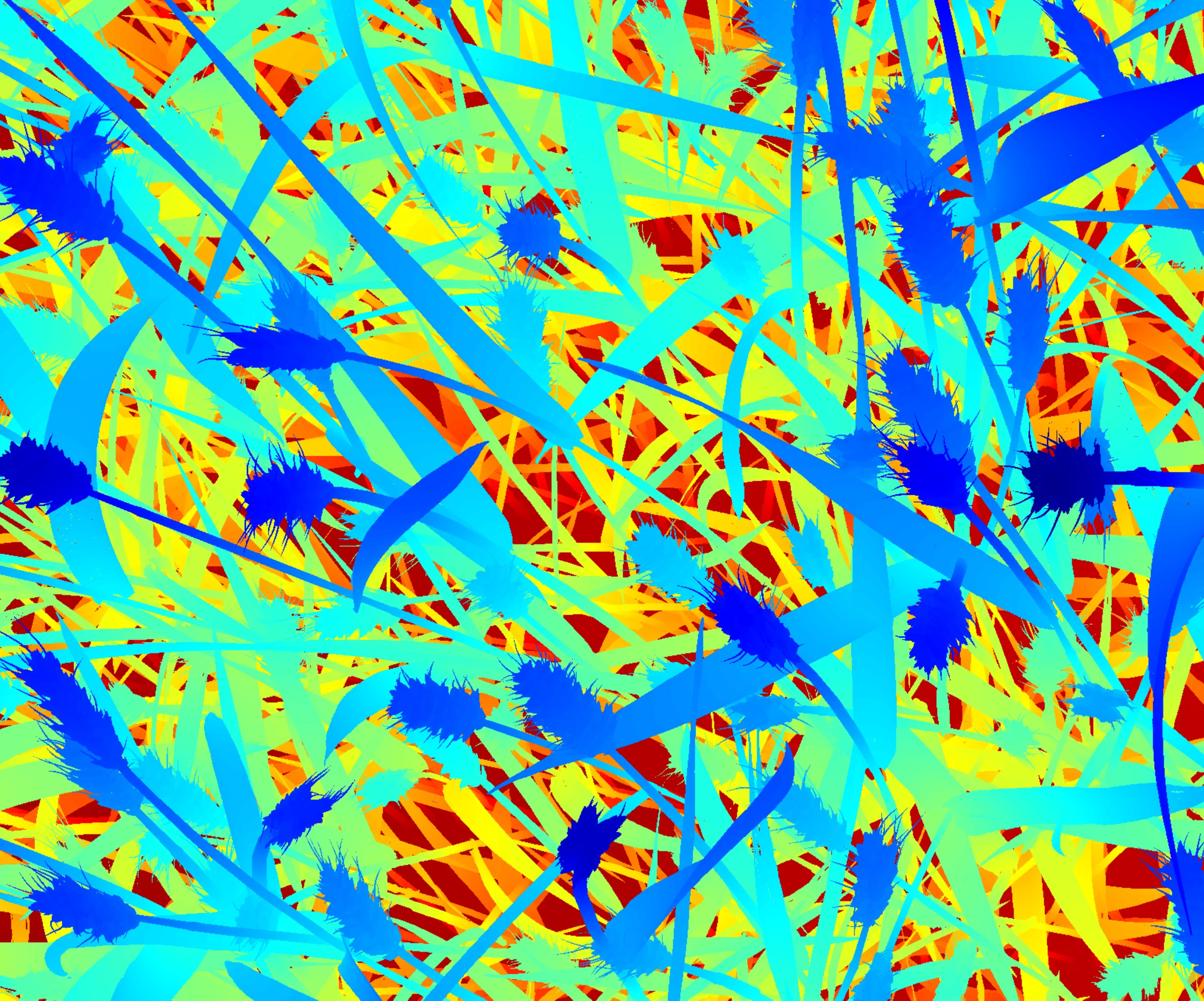

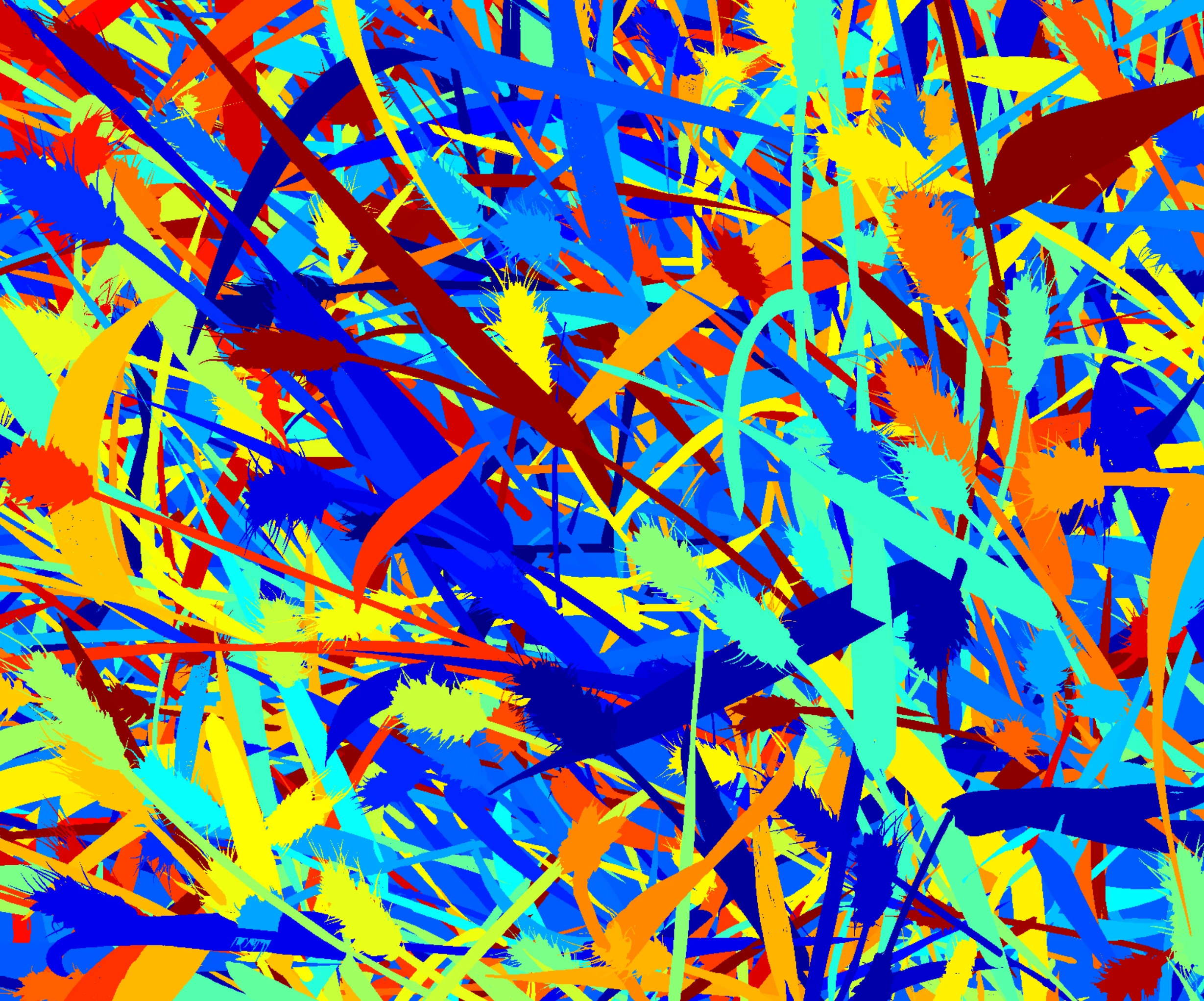

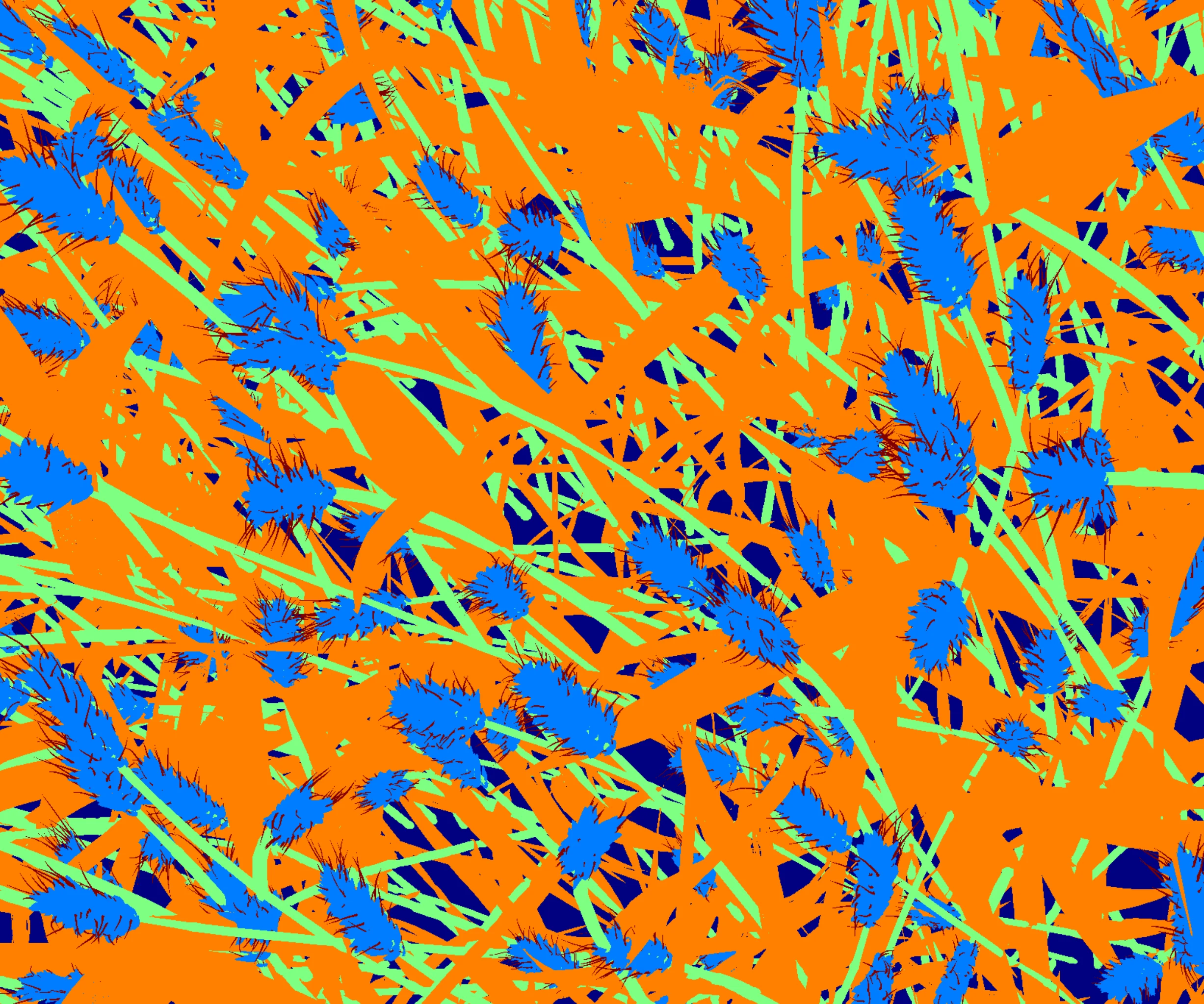

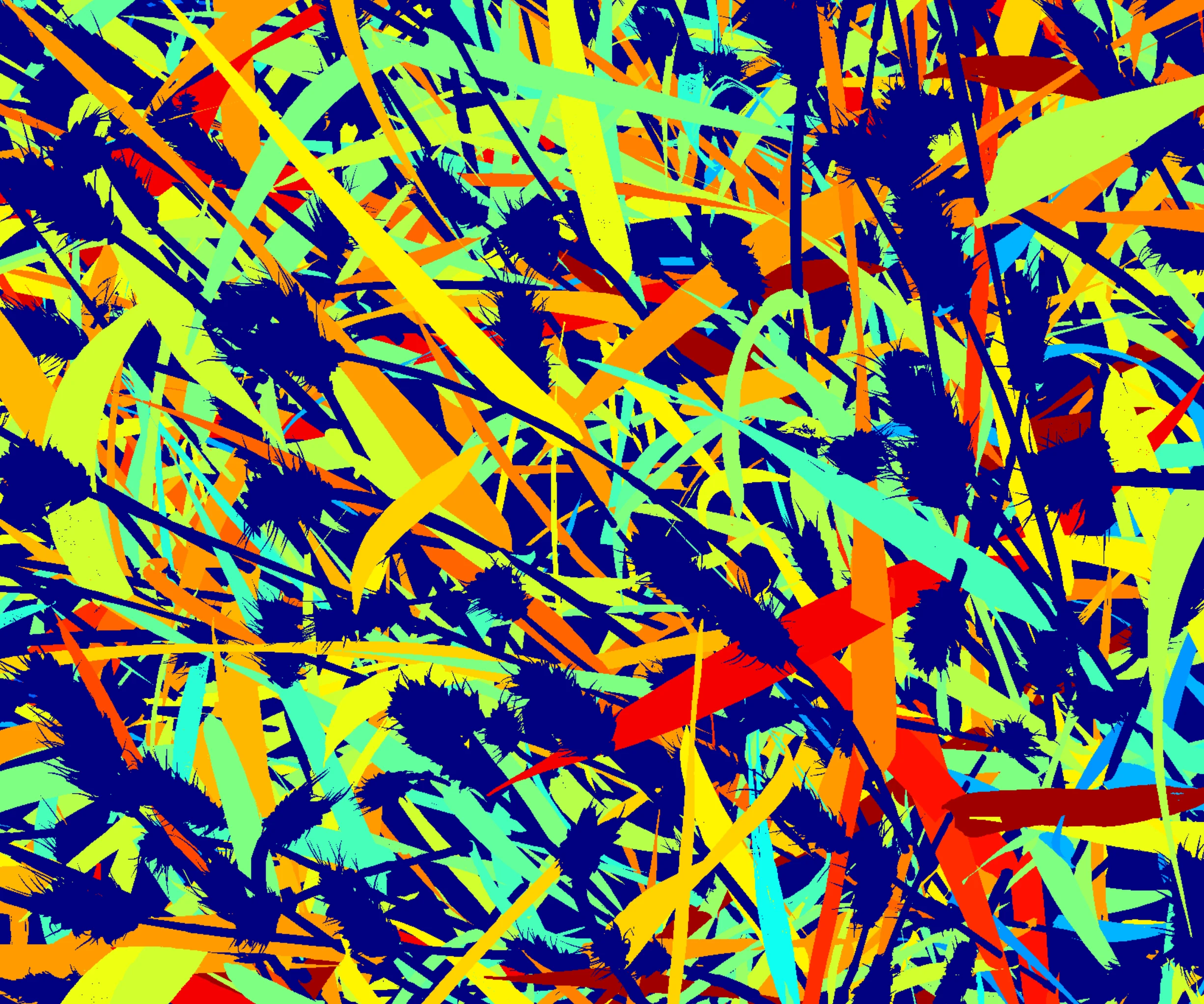

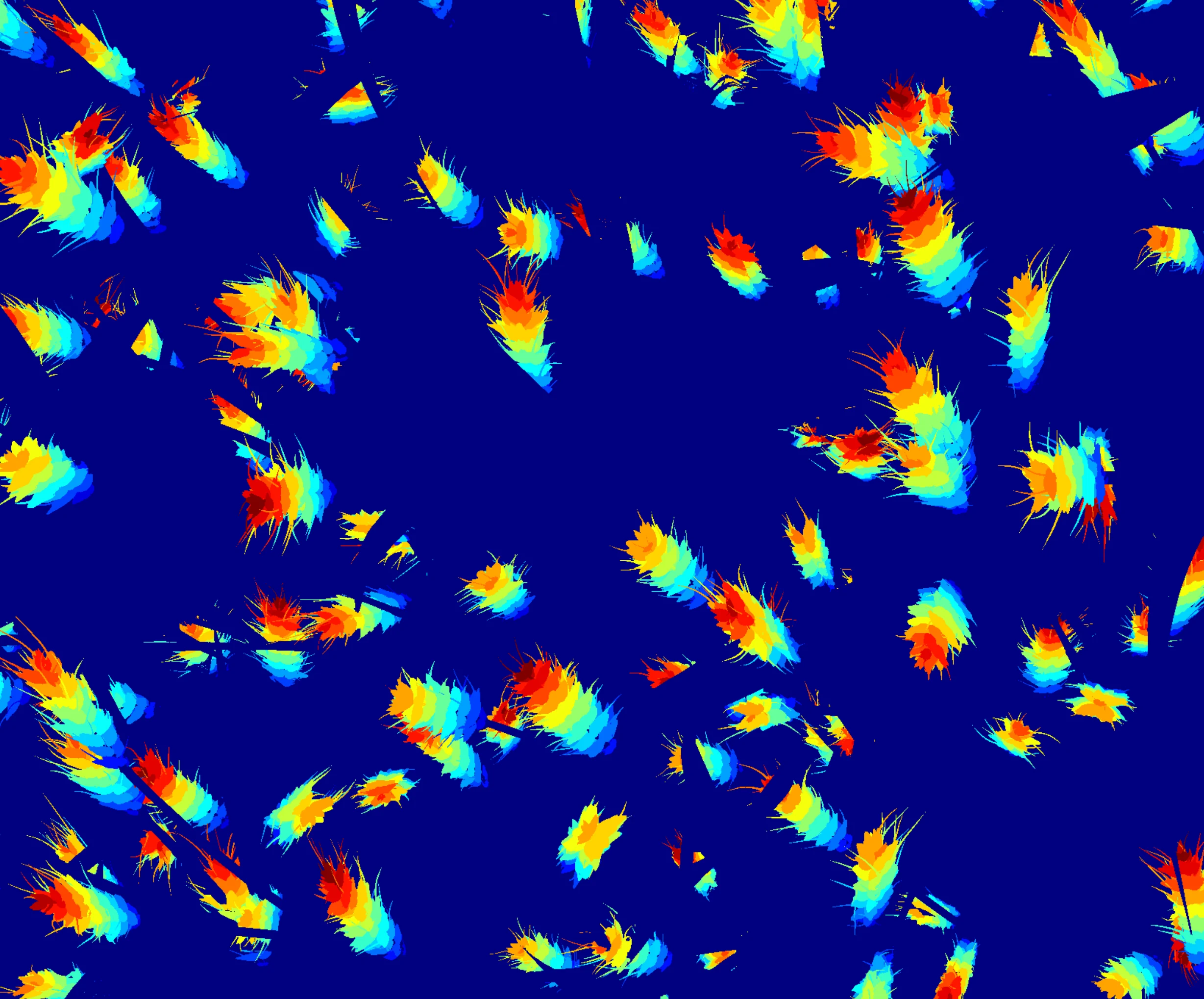

Qualitative Beispiele

Die Fehler eines Modells hängen vom Erscheinungsbild der Daten ab. Im Folgenden zeigen wir repräsentative Trainingsbilder aus allen drei Quellen. Simulator-Renderings sind klar als synthetisch zu erkennen, echte GWHD-Fotos wirken erwartungsgemäß real, und die GenAI-Varianten verschieben den Simulator-Output in Licht- und Wetterverhältnisse, die sich mit einer echten Kamera nur schwer gezielt einfangen lassen.

Das Setup

GWHD ist eigentlich kein einzelner Datensatz, sondern ein Benchmark, der aus Forschungsinstituten in mehreren Ländern zusammengestellt wurde. Jedes Institut arbeitet mit anderen Kameras, in anderen Klimazonen und zu anderen Wachstumsstadien. Genau diese Variation ist es, die zählt, wenn ein Detektor auf einem neuen Betrieb eingesetzt wird.

Ein zufälliger Train/Test-Split würde es dem Modell erlauben, eine einzelne Forschungsstation auswendig zu lernen und trotzdem glänzend auf dem Testset abzuschneiden. Deshalb haben wir nach Quelle aufgeteilt: Trainingsbilder aus Frankreich, Validierung aus der Schweiz, Testset aus Kanada und Großbritannien. Jede genannte Zahl ist der Score des Modells auf Kameras, Bedingungen und Wachstumsstadien, die es im Training nie gesehen hat.

| Split | Domänen | Bilder | Annotationen |

|---|---|---|---|

| Testdurchgehend ausgeklammert | usask_1, rres_1 (Canada + UK) | 632 | 25,195 |

| Validierung | ethz_1 (Switzerland) | 747 | 49,603 |

| Trainings-Pool | arvalis_1/2/3, inrae_1 (France) | 2,043 | 70,613 |

Jedes Ergebnis in diesem Beitrag wird auf denselben 632 kanadischen und britischen Bildern evaluiert. Aufgenommen wurden sie mit Kameras, bei Lichtverhältnissen und in Wachstumsstadien, die das Modell im Training nie gesehen hat. Die Simulator- und GenAI-Sets werden ausschließlich für das Training verwendet und fließen nie in Validierung oder Test ein.

Modell: YOLO26-m (Ultralytics 8.4.19) bei 640px, Batch 16, RTX 5090. Wir berichten mAP@50 und das härtere mAP@50-95.

Ergebnisse

1. Vergleich bei gleichem Budget

Wir beginnen mit einem Vergleich bei gleichem Budget: Das Trainings-Budget wird auf 701 Bilder festgesetzt, nur die Datenquelle variiert. So lässt sich der Beitrag jeder einzelnen Quelle unter identischen Trainings- und Evaluierungsbedingungen isolieren.

Ein 50/50-Mix aus Synthetic und Real schlägt beide reinen Quellen bei gleichem Gesamtbudget.

Drei Dinge fallen auf. Reines Synthetic liegt etwa 2,4 mAP@50 hinter Real. Das ist die messbare Sim-to-Real-Lücke, die die restlichen Experimente zu schließen versuchen. Die GenAI-Überarbeitung schließt rund 60 % dieser Lücke, und das ohne neue Labels: dieselben simulierten Szenen, dieselben Bounding Boxes, nur mehr visuelle Vielfalt durch das Image-to-Image-Modell. Am wichtigsten ist aber: Ein 50/50-Mix aus Synthetic und Real schlägt beide reinen Quellen bei gleichem Gesamtbudget. Die beiden Quellen vermitteln dem Modell tatsächlich unterschiedliche Dinge, und das Modell profitiert davon, beide zu sehen.

2. Reichen mehr echte Daten?

Eine naheliegende Folgefrage: Wenn die Sim-to-Real-Lücke real ist, lässt sie sich nicht einfach durch mehr echte Daten schließen? Wir haben auf dem vollständigen Trainings-Pool von 2.000 echten Bildern trainiert und das Ergebnis mit der gemischten Konfiguration aus 701 Bildern verglichen.

| Konfiguration | Bilder | mAP@50 | mAP@50-95 |

|---|---|---|---|

| Real only | 2,000 | 0.9299 | 0.5225 |

| Real only | 701 | 0.9164 | 0.5292 |

| Mix (synth + real)350 / 351 | 701 | 0.9335 | 0.5184 |

701 gemischte Bilder schlagen 2.000 echte Bilder auf mAP@50 und liegen beim schwierigeren mAP@50-95 praktisch gleichauf. Jenseits einer bestimmten Schwelle ist die Vielfalt der Trainingsbilder wichtiger als ihre schiere Anzahl. Das ist das Ergebnis mit den klarsten praktischen Auswirkungen: erheblicher Annotationsaufwand eingespart, ohne nennenswerte Einbußen bei der Performance.

3. Alles kombinieren

Die Headline-Konfiguration. Real, Synthetic und GenAI zusammen.

Die GenAI-Überarbeitung verbreitert die visuelle Verteilung, die das Netzwerk während des Trainings sieht. Andere Beleuchtung, anderes Wetter, andere atmosphärische Bedingungen, aufgesetzt auf einer bereits starken Basis aus Real und Synthetic. Dieselben Labels, mehr Vielfalt, bessere Generalisierung.

Was wir gelernt haben

Synthetic allein kommt nah heran, aber nicht ganz an Real.

0,89 vs. 0,92 mAP@50 bei gleichem Bild-Budget. Die Sim-to-Real-Lücke ist real und sollte beim Planen eines Datensatzes explizit berücksichtigt werden.

Ein 50/50-Mix schlägt jede Quelle einzeln, und sogar fast 3× so viele echte Daten.

Das ist die Kernaussage. Synthetic und Real vermitteln dem Modell unterschiedliche Dinge, und zusammen sind sie wirklich synergetisch.

GenAI-Überarbeitung liefert günstige visuelle Vielfalt.

Dieselben Labels, mehr visuelle Vielfalt, messbare Gewinne gegenüber reinen Synthetic- und Mix-Baselines. Rund 60 % der Sim-to-Real-Lücke geschlossen, zum Preis von wenigen hundert Image-to-Image-Aufrufen.

Das beste Rezept sind alle drei.

Real verankert Realismus. Synthetic liefert geometrische Präzision und exakte Annotationen in beliebiger Menge. GenAI verbreitert die Verteilung der Erscheinungsbilder. Zusammen: 0,937 mAP@50 auf Ländern, auf denen das Modell nie trainiert wurde.

Mehr als nur Bounding Boxes

In dieser Studie haben wir Objekterkennung untersucht. Sie ist nur eine von vielen Aufgaben, für die sich synthetische Daten eignen. Da jedes Rendering eine vollständig beschriebene 3D-Szene ist, lässt sich jede Annotation, die auf Geometrie, Materialien oder Szenen-Metadaten basiert, ohne zusätzlichen Aufwand aus derselben Pipeline exportieren.

Die Annotationen unten stammen alle aus demselben gerenderten Frame. Dieselbe Szene liefert zum selben Zeitpunkt jeden Labeltyp — keine davon musste manuell erstellt werden.

Wir haben Bounding Boxes evaluiert. In der Praxis reichen sie selten allein. Synthetische Daten erlauben es, die Aufgabe zu wechseln, ohne den Datensatz neu aufzubauen.

Bauen Sie Erkennungsmodelle für den Feldeinsatz?

Wenn Annotation Ihr Engpass ist, können wir helfen. Simmetry erstellt simulatorbasierte synthetische Datensätze für Kulturpflanzen und Feldarbeiten, mit konsistenten Labels und kontrollierbarer Varianz, damit Sie schneller trainieren und iterieren können, ohne Abstriche bei einer sauberen Auswertung.

usask_1 + rres_1 (632 Bilder, 25.195 Annotationen). Validierung: ethz_1. Modell: YOLO26-m, 640px, Batch 16. Synthetische Bounding Boxes abgeleitet aus Instanzmasken ∩ semantischer Maske wheat_parts. GenAI-Augmentationen erzeugt durch Image-to-Image-Übersetzung mit Prompts zu Beleuchtung, Wetter und Atmosphäre; die Prompts erhalten die Pflanzengeometrie ausdrücklich, sodass die ursprünglichen Labels gültig bleiben. Alle Experimente wurden auf demselben zurückgehaltenen Testset evaluiert.